ИИ можно «взломать» с помощью антенны

До недавнего времени казалось, что системы искусственного интеллекта невозможно «взломать» без прямого доступа к коду или инфраструктуре. Однако новое исследование международной группы учёных показывает: даже без подключения к системе можно получить важную информацию о том, как устроена нейросеть.

Речь идёт о работе команды под руководством профессора Джун Хана из Корейского института передовых технологий (KAIST), которая совместно с исследователями из Национального университета Сингапура и Чжэцзянского университета разработала метод под названием ModelSpy. В отличие от классических кибератак, он не требует взлома серверов или установки вредоносного ПО. Вместо этого используется анализ электромагнитных сигналов, которые излучает оборудование во время работы.

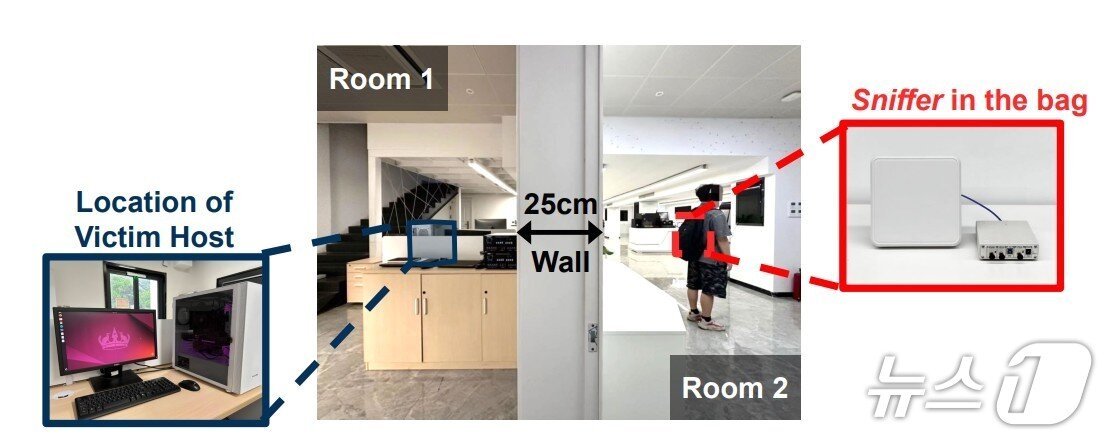

Когда нейросеть выполняет вычисления, графические процессоры создают слабые электромагнитные волны. Эти сигналы практически незаметны, но их можно зафиксировать с помощью антенны и затем проанализировать. Учёным удалось доказать, что по таким сигналам можно восстановить структуру модели — например, определить количество слоёв и их типы. В лабораторных условиях точность достигала почти 98%, а саму атаку удалось провести на расстоянии до шести метров, в том числе через стены.

При этом важно понимать, что речь не идёт о полноценном взломе в привычном смысле. Метод не даёт доступа к данным, не позволяет управлять системой и не раскрывает точные веса модели. Однако он демонстрирует, что даже «закрытые» ИИ-системы могут утекать информацию через физические побочные каналы. Это, в свою очередь, может помочь злоумышленникам создавать более точные атаки в будущем.

Исследование уже представили на одной из крупнейших конференций по кибербезопасности — Network and Distributed System Security Symposium 2026, где оно получило признание как инновационная работа. Пока технология остаётся скорее научной демонстрацией, чем практическим инструментом для атак: для её реализации нужны специальное оборудование, близкое расстояние и глубокая экспертиза.

Тем не менее выводы исследователей звучат однозначно: безопасность искусственного интеллекта больше не ограничивается только программным уровнем. Теперь она включает и физические аспекты — от излучения оборудования до защиты от побочных каналов утечки информации.